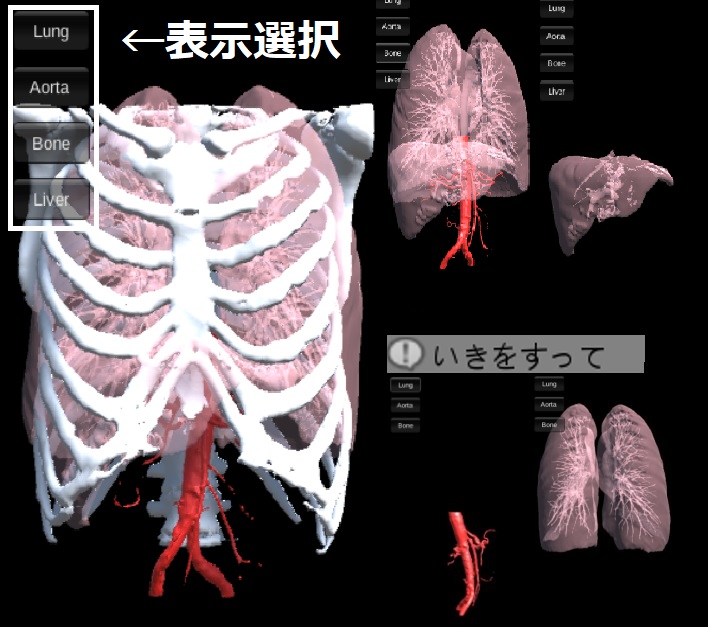

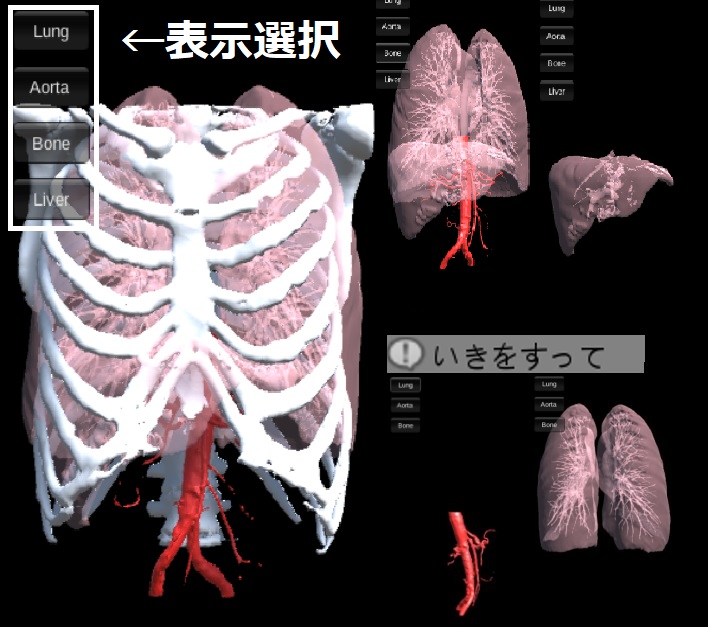

当研究室では医学部や薬学部の先生と共同研究を行って、次世代の教育システムや外国人向けの薬ナビゲーションアプリ開発を行っています。実際の人の肺の形状をコンピュータ上で、仮想現実のVRシステムを用いて吸気や排気時の動きをリアルタイムアニメーションを行なう事ができます。その際に様々な個所に、必要な音情報を配置することによって、なぜそのような音がするのか?なぜそこに聴診器を当てないといけないのかを理解するための支援を行います。

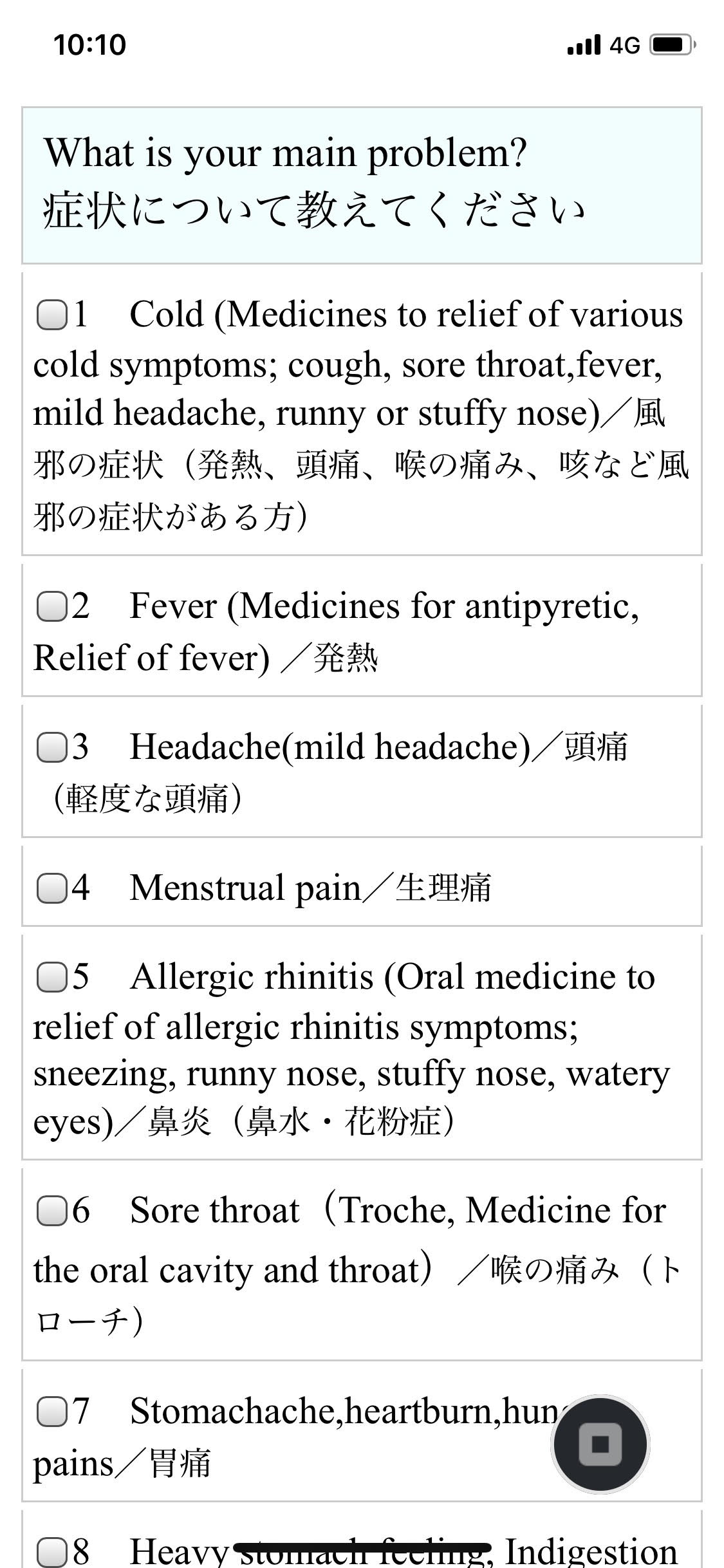

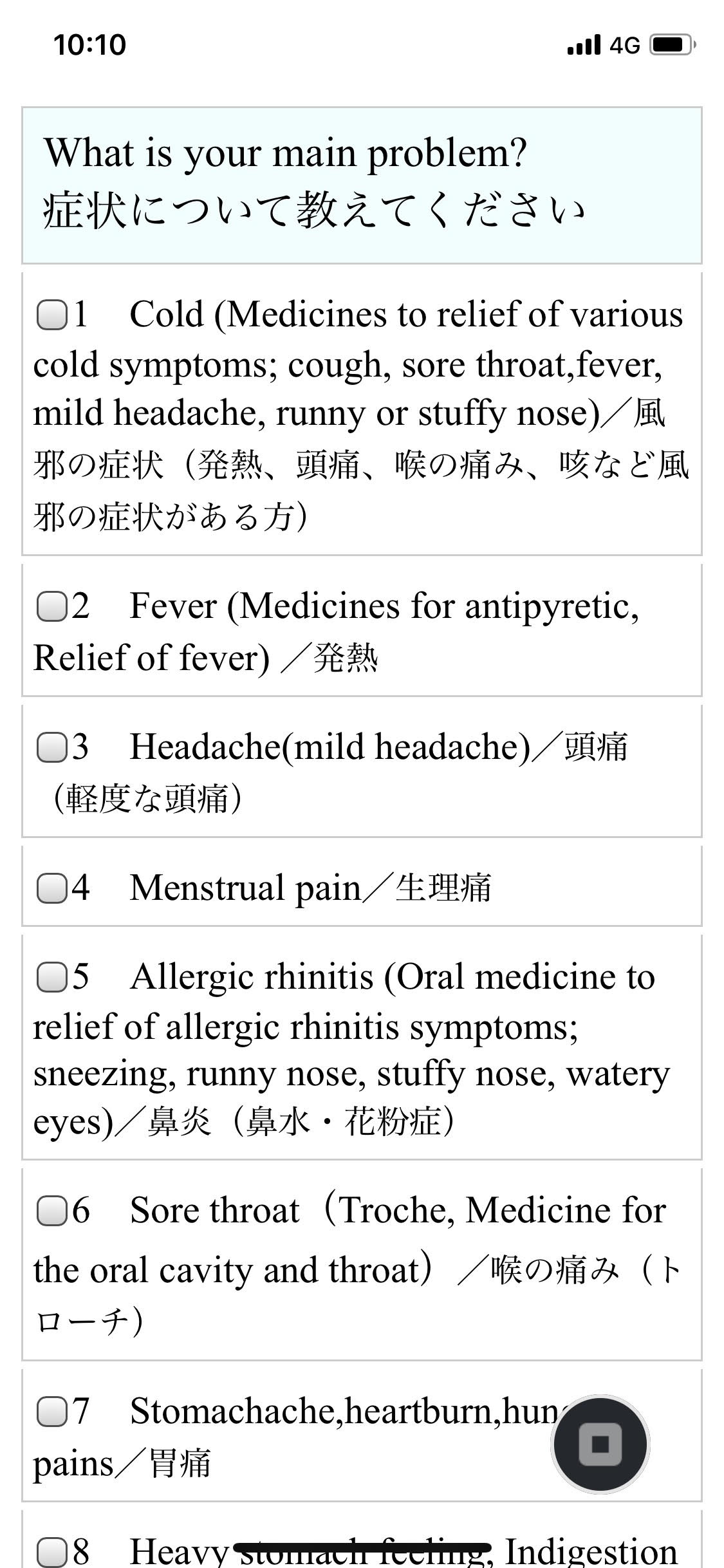

下記は実際には「息を大きく吸って下さい」など、声によってインタラクティブに動作する次世代教育用問診システムの画面一例になります。

上記をクリックするとデータのVR画像がWebブラウザで表示されます(次の画面でWebGLがサポートされていないと表示されますが、OKを押すと通常は問題無く表示されます。音声認識は非対応です)。

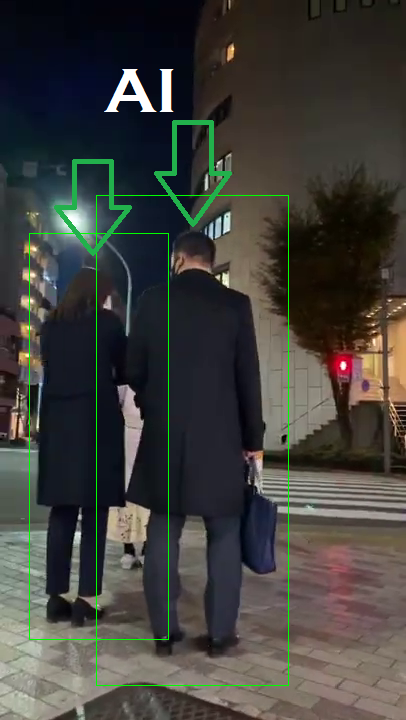

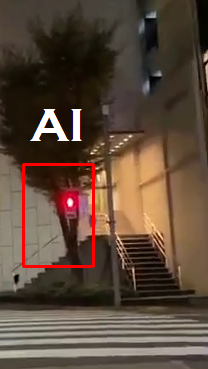

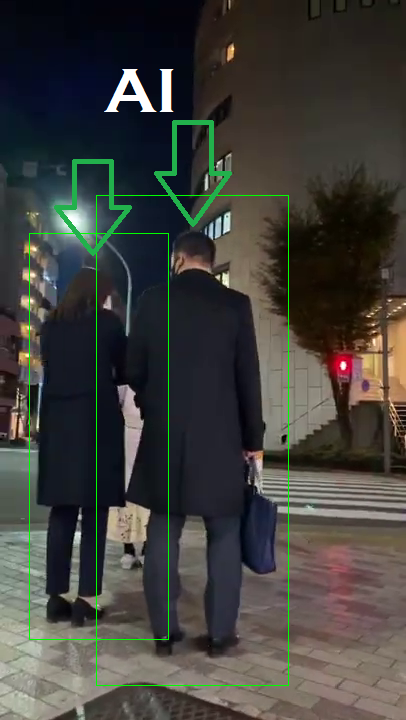

視覚障害者向けAI

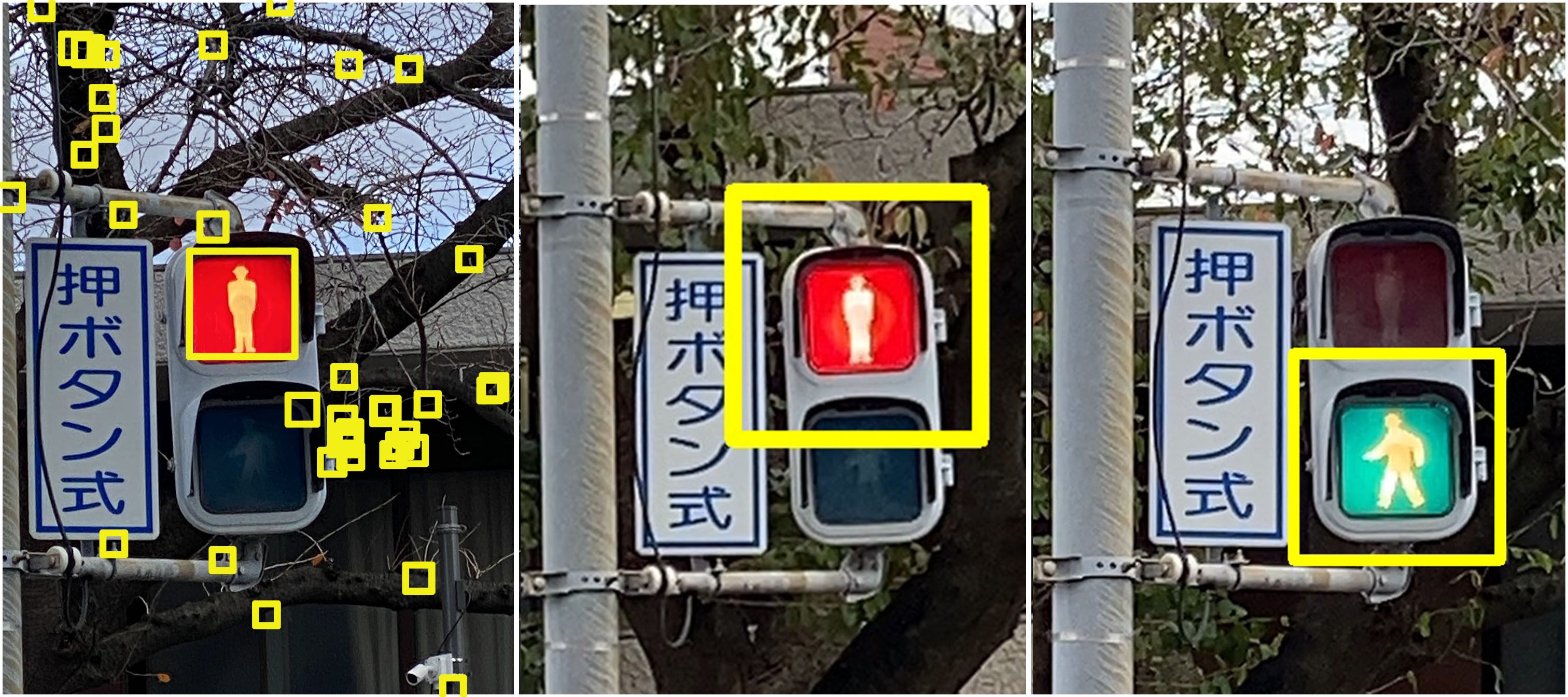

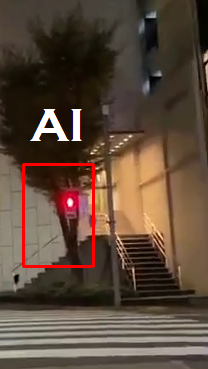

ほとんどの歩行者用信号機は、視覚障がい者対応ではありません。盲導犬の供給は全く追い付かず、常に足元の段差や階段で転倒するリスクと向き合って生活しています。そこで視覚障がい者が自ら自由に行動できる社会へ向けて、人工知能AIを活用した歩行ナビシステムの研究を行っています。次の画像は、人間を認識したり、歩行者用の赤信号を認識した結果が示されています。

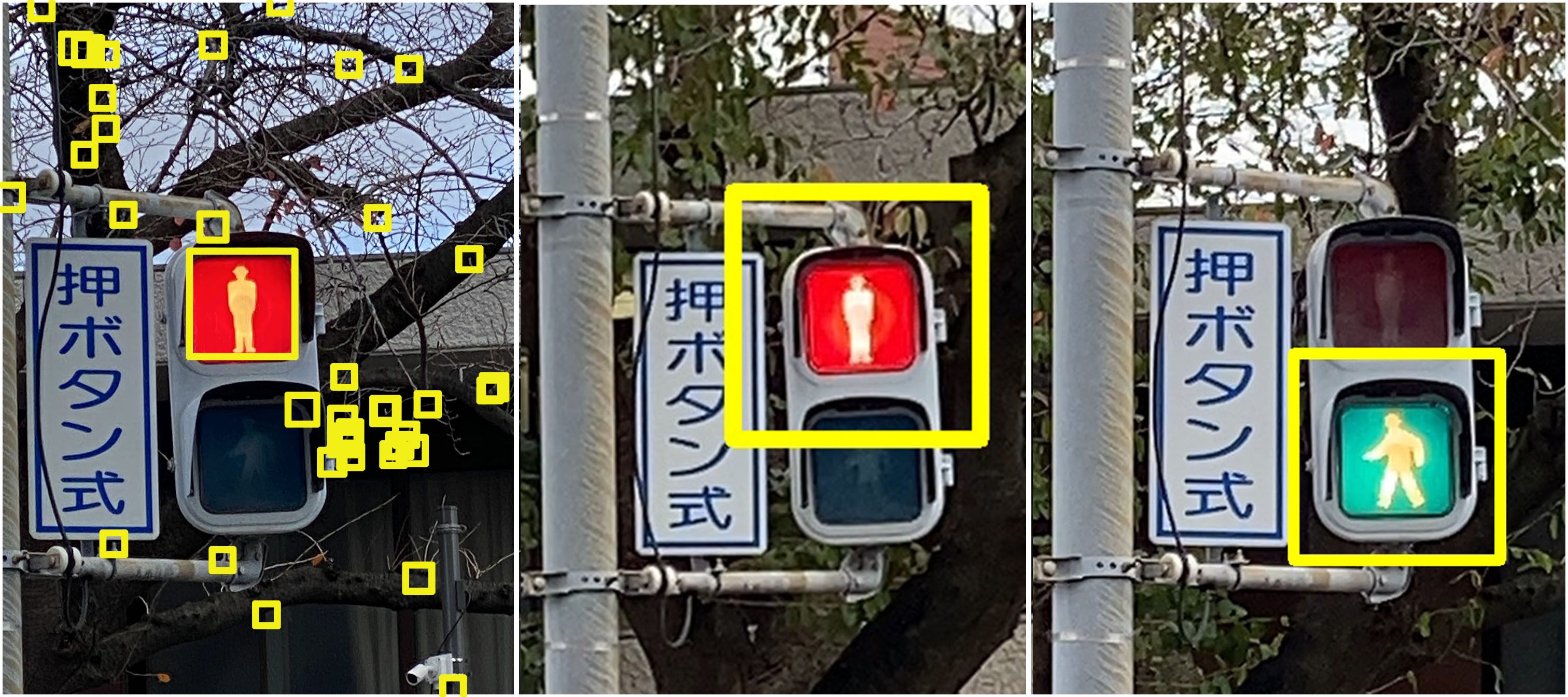

上の結果は一番左側が信号の色情報を基に認識した結果で、赤信号以外に少しでも赤色成分が混じっている箇所等を全て認識している状況です。AI・機械学習の一つであるカスケード分類器やYOLO(You Look Only Once)を使って、多くの画像を利用して信号機の形状を学習させると、右のように正しく信号を認識できるようになります。

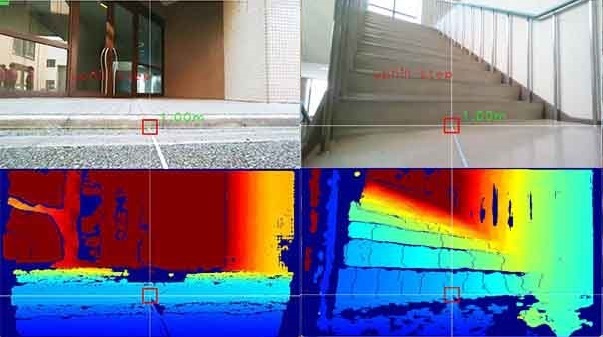

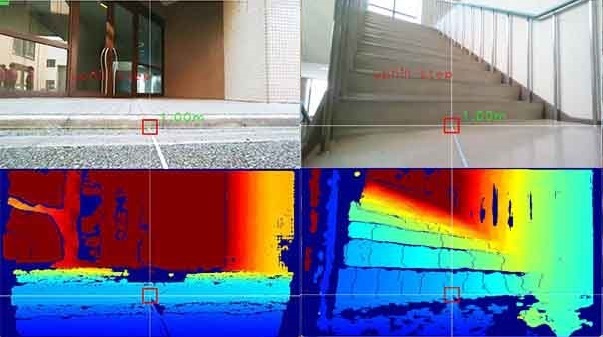

下は左右2台のカメラを用いて距離を計算して、周囲との距離の変化を基に、視覚障がい者に危険な段差を認識した例です。赤色が遠くで青色が近くの距離を表しています。

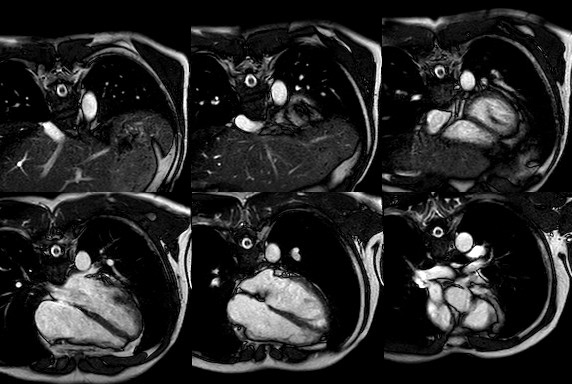

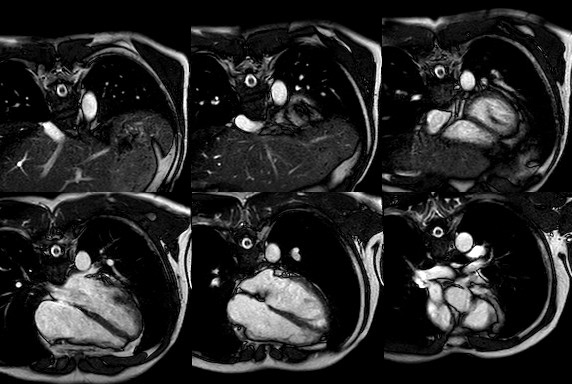

次はMRI画像をアニメーションで表示させて全体像を把握しやすくしたシステムの画面の一部です。

上記をクリックするとシステムの一部がWebブラウザで表示されます。

下記は実際には「息を大きく吸って下さい」など、声によってインタラクティブに動作する次世代教育用問診システムの画面一例になります。

上記をクリックするとデータのVR画像がWebブラウザで表示されます(次の画面でWebGLがサポートされていないと表示されますが、OKを押すと通常は問題無く表示されます。音声認識は非対応です)。

視覚障害者向けAI

ほとんどの歩行者用信号機は、視覚障がい者対応ではありません。盲導犬の供給は全く追い付かず、常に足元の段差や階段で転倒するリスクと向き合って生活しています。そこで視覚障がい者が自ら自由に行動できる社会へ向けて、人工知能AIを活用した歩行ナビシステムの研究を行っています。次の画像は、人間を認識したり、歩行者用の赤信号を認識した結果が示されています。

上の結果は一番左側が信号の色情報を基に認識した結果で、赤信号以外に少しでも赤色成分が混じっている箇所等を全て認識している状況です。AI・機械学習の一つであるカスケード分類器やYOLO(You Look Only Once)を使って、多くの画像を利用して信号機の形状を学習させると、右のように正しく信号を認識できるようになります。

下は左右2台のカメラを用いて距離を計算して、周囲との距離の変化を基に、視覚障がい者に危険な段差を認識した例です。赤色が遠くで青色が近くの距離を表しています。

次はMRI画像をアニメーションで表示させて全体像を把握しやすくしたシステムの画面の一部です。

上記をクリックするとシステムの一部がWebブラウザで表示されます。

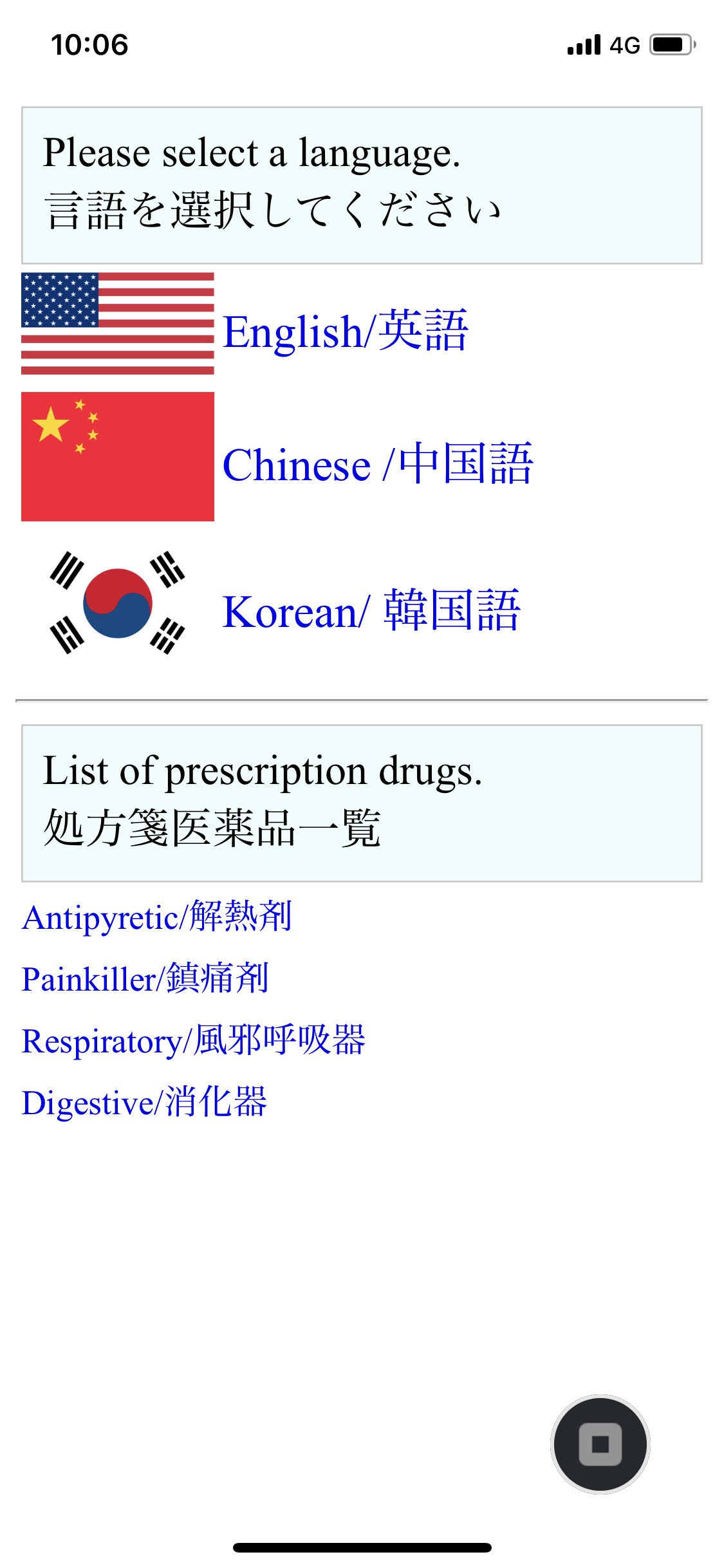

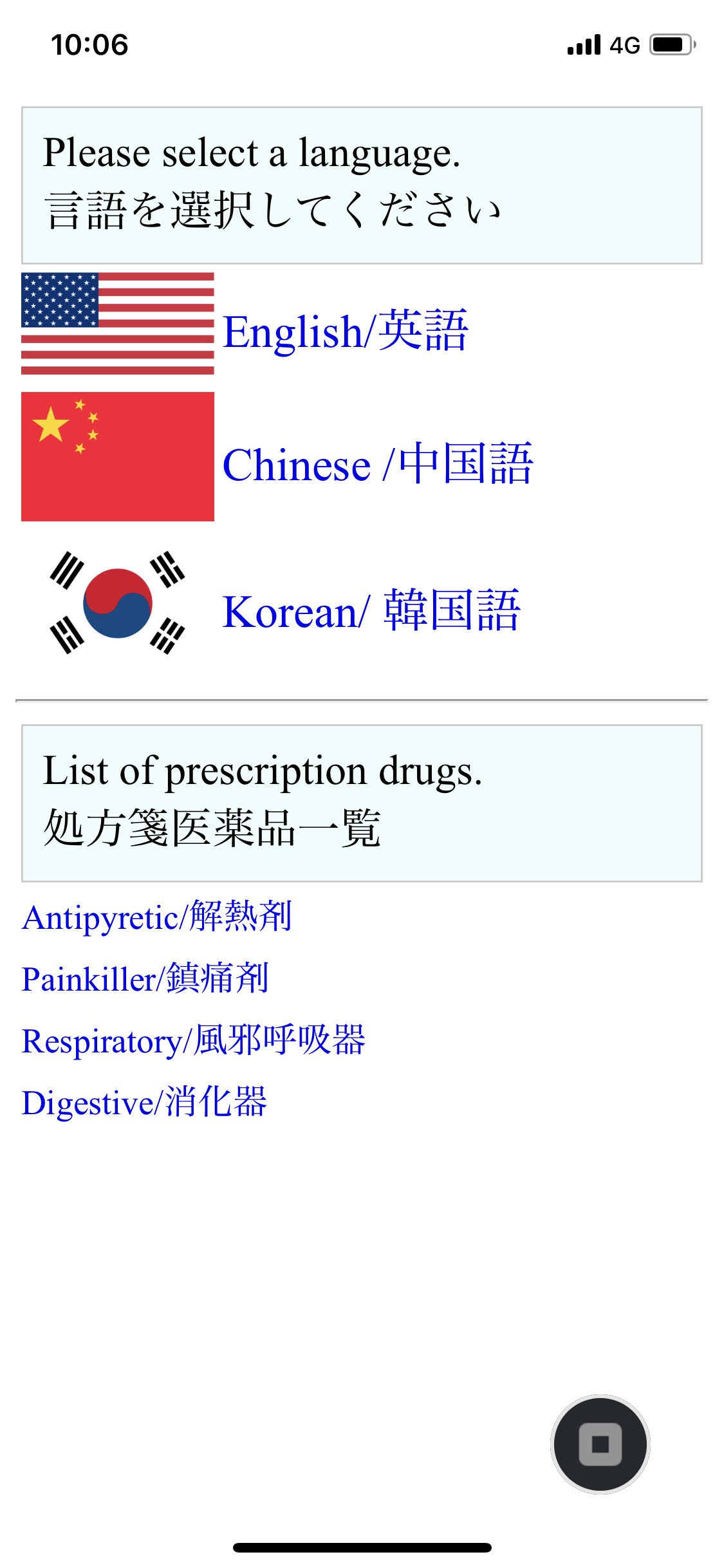

下の図は、外国人向けの薬局でのスマホ向け薬ナビアプリです。例えば私達が外国に行って具合が悪くなった際に薬局に入るとどれも知らない製品ばかりで、表記を見ても日本語は無く、英語も専門用語ばかりで、どれを買えば良いのか大変に困るでしょう。いまこれが外国人が日本で感じている問題なので、これを解決するためのスマホ・アプリ開発を、薬学部の先生や学生と共同開発しています。

審査付論文一覧口頭発表原稿一覧